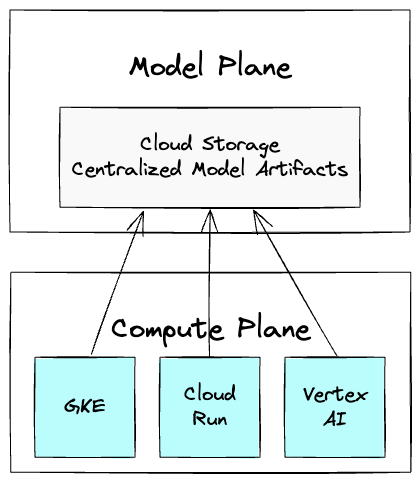

La gestión de artefactos de modelos grandes es un desafío significativo en MLOps, lo que a menudo conduce a despliegues lentos. Desacoplar los modelos del código alojándolos en Cloud Storage ofrece una solución más ágil. Centralizar los modelos en Cloud Storage los trata como un activo de primera clase con su propio ciclo de vida, separado del cómputo. Esto crea un plano de modelo distinto para la gobernanza y un plano de cómputo para la inferencia. Esta separación permite que una única versión de modelo se utilice en GKE, Cloud Run y Vertex AI sin duplicación. Las mejores prácticas para la organización incluyen convenciones de nombres claras y prefijos específicos del entorno en Cloud Storage. El control de acceso a través de IAM es crucial para la seguridad y la gestión de diferentes permisos de usuario. La cuantización reduce el tamaño del modelo y acelera la inferencia al disminuir la precisión. El calentamiento de la caché puede mejorar el tiempo de procesamiento de la indicación inicial precalculando solicitudes comunes. El controlador FUSE CSI de Cloud Storage es un método recomendado para montar cubos de Cloud Storage directamente en pods de GKE, lo que permite un inicio casi instantáneo. Para necesidades de rendimiento extremas, Google Cloud Managed Lustre o Hyperdisk ML ofrecen soluciones especializadas de almacenamiento de archivos paralelos y bloques.

cloud.google.com

Scalable AI starts with storage: Guide to model artifact strategies

Create attached notes ...