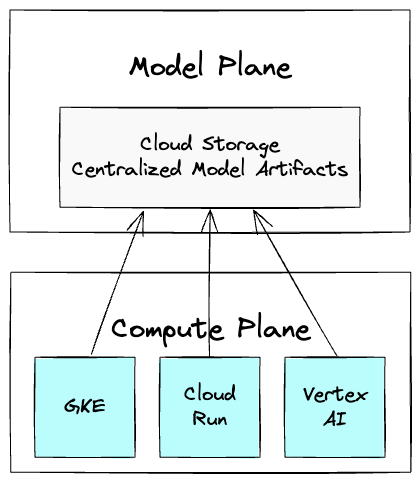

La gestion des artefacts de grands modèles est un défi majeur en MLOps, entraînant souvent des déploiements lents. Dissocier les modèles du code en les hébergeant dans Cloud Storage offre une solution plus agile. La centralisation des modèles dans Cloud Storage les traite comme un actif de première classe avec son propre cycle de vie, séparé du calcul. Cela crée un plan de modèle distinct pour la gouvernance et un plan de calcul pour l'inférence. Cette séparation permet d'utiliser une seule version de modèle sur GKE, Cloud Run et Vertex AI sans duplication. Les meilleures pratiques d'organisation incluent des conventions de nommage claires et des préfixes spécifiques à l'environnement dans Cloud Storage. Le contrôle d'accès via IAM est crucial pour la sécurité et la gestion des différentes autorisations utilisateur. La quantification réduit la taille du modèle et accélère l'inférence en abaissant la précision. Le cache warming peut améliorer le temps de traitement des invites initiales en pré-calculant les requêtes courantes. Le pilote CSI FUSE de Cloud Storage est une méthode recommandée pour monter directement les buckets Cloud Storage dans les pods GKE, permettant un démarrage quasi instantané. Pour des besoins de performance extrêmes, Google Cloud Managed Lustre ou Hyperdisk ML offrent des solutions spécialisées de stockage de fichiers parallèles et de blocs.

cloud.google.com

Scalable AI starts with storage: Guide to model artifact strategies

Create attached notes ...