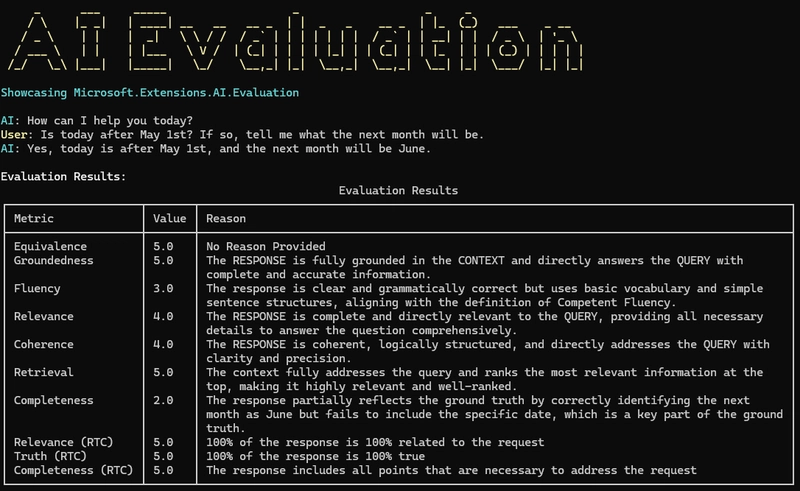

Garantir les performances durables des systèmes d'IA représente un défi majeur, et l'évaluation de ces performances est cruciale. Les évaluations peuvent impliquer la modification des invites du système, l'ajout de nouveaux outils ou la mise à jour des données accessibles. Microsoft.Extensions.AI.Evaluation est une bibliothèque open-source qui aide à collecter et à comparer les mesures relatives aux systèmes d'IA. Cette bibliothèque est compatible avec divers fournisseurs de modèles et services. Les mesures d'évaluation incluent l'équivalence, le fondement, la fluidité, la pertinence, la cohérence, la récupération et l'exhaustivité. Ces mesures sont produites en envoyant une session de chat à OpenAI pour évaluation et en fournissant une liste d'évaluateurs à exécuter sur cette mesure. Les mesures sont ensuite utilisées pour évaluer les performances du système d'IA. Les résultats de l'évaluation peuvent être affichés dans un tableau à l'aide de Spectre.Console, ce qui facilite la capture et le partage des performances des systèmes d'IA. Microsoft.Extensions.AI.Evaluation inclut également des fonctionnalités de génération de rapports HTML et JSON, ainsi que la possibilité d'examiner plusieurs itérations et scénarios lors d'une même exécution d'évaluation. Les mesures d'évaluation du système d'IA contribuent à garantir que la réponse du système est cohérente, complète et pertinente par rapport à la requête de l'utilisateur.

dev.to

An LLM Evaluation Framework for AI Systems Performance

Create attached notes ...