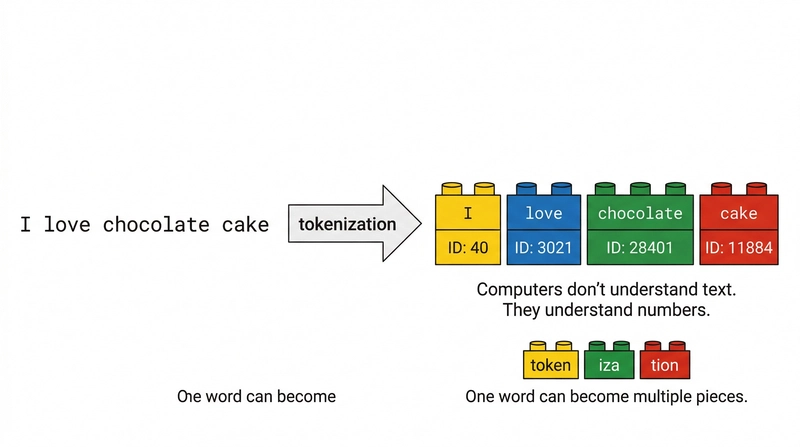

文章解释了大型语言模型(LLM)的工作原理,将其比作乐高工厂。LLM 通过将单词转换为模型能够理解的“词元”(token)来处理文本。上下文窗口是模型的“工作空间”,其容量有限,直接影响模型可考虑的信息量。文本生成过程涉及模型基于概率预测下一个词元,这些概率由注意力机制生成。该机制对每个词元相对于其他词元的重要性进行加权,有助于消除歧义。模型依据概率分布选择词元,而温度(temperature)和 top-p 等参数则控制生成的随机性。葡萄牙语文本会产生“词元化溢价”,需要比英文更多的词元,从而增加成本并缩小有效上下文窗口的大小。上下文窗口的大小是影响模型性能的关键因素。由于模型运行机制,文本生成的成本高于输入成本。对提示词进行恰当的结构化设计,即提示工程(prompt engineering),有助于引导注意力机制并提升结果。文章强调,理解这些机制对于有效利用和优化大型语言模型至关重要。

dev.to

Claude Code 101: Demystifying Language Models

Create attached notes ...