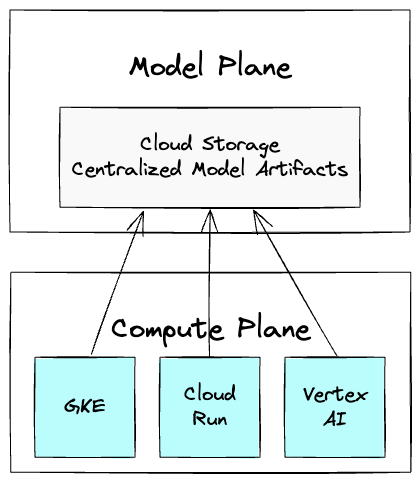

Das Verwalten großer Modell-Artefakte ist eine erhebliche Herausforderung im MLOps und führt oft zu langsamen Bereitstellungen. Das Entkoppeln von Modellen vom Code, indem sie im Cloud Storage gehostet werden, bietet eine agilere Lösung. Die Zentralisierung von Modellen im Cloud Storage behandelt sie als erstklassige Assets mit eigenem Lebenszyklus, getrennt von der Rechenleistung. Dies schafft eine separate Modell-Ebene für die Governance und eine Rechen-Ebene für die Inferenz. Diese Trennung ermöglicht die Verwendung einer einzigen Modellversion über GKE, Cloud Run und Vertex AI hinweg ohne Duplizierung. Bewährte Verfahren für die Organisation umfassen klare Namenskonventionen und umgebungsspezifische Präfixe im Cloud Storage. Die Zugriffskontrolle über IAM ist entscheidend für die Sicherheit und die Verwaltung unterschiedlicher Benutzerberechtigungen. Quantisierung reduziert die Modellgröße und beschleunigt die Inferenz durch Verringerung der Präzision. Das Aufwärmen des Caches kann die anfängliche Verarbeitungszeit von Prompts verbessern, indem häufige Anfragen vorab berechnet werden. Der Cloud Storage FUSE CSI-Treiber ist eine empfohlene Methode, um Cloud Storage-Buckets direkt in GKE-Pods einzubinden und so einen nahezu sofortigen Start zu ermöglichen. Für extreme Leistungsanforderungen bieten Google Cloud Managed Lustre oder Hyperdisk ML spezialisierte parallele Datei- und Blockspeicherlösungen.

cloud.google.com

Scalable AI starts with storage: Guide to model artifact strategies