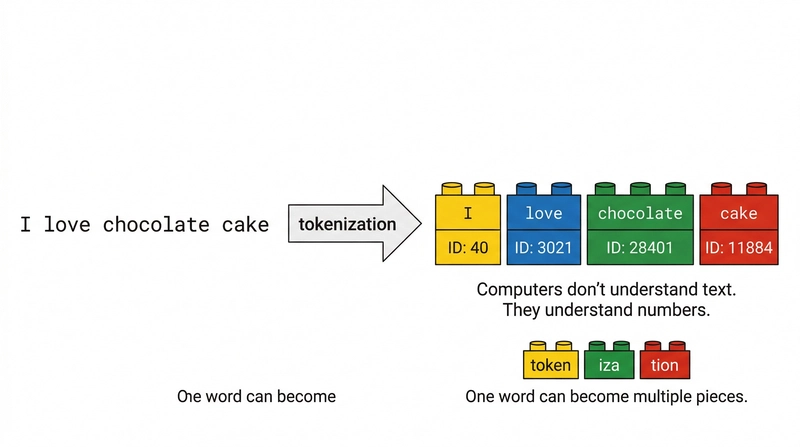

この記事は、大規模言語モデル(LLM)の仕組みを説明しており、それをレゴ工場に例えています。LLMは、単語をモデルが理解できるデータの単位であるトークンに変換することでテキストを処理します。コンテキストウィンドウ、つまりモデルの作業空間にはサイズ制限があり、それが考慮できる情報の量に影響します。テキスト生成のプロセスでは、モデルはアテンションメカニズムによって作成された確率に基づいて、次のトークンを予測します。このメカニズムは、他のトークンとの関係において各トークンの重要性を重み付けし、意味の曖昧さを解消するのに役立ちます。モデルは、温度やtop-p設定(ランダム性を制御)の影響を受ける確率分布に基づいてトークンを選択します。ポルトガル語のテキストは「トークン化プレミアム」が発生し、英語よりも多くのトークンを必要とするため、コストが増加し、有効なコンテキストウィンドウサイズが減少します。コンテキストウィンドウのサイズは、モデルのパフォーマンスに影響を与える重要な要素です。テキスト生成のコストは、モデルの動作メカニズムにより、入力のコストよりも高くなります。プロンプトエンジニアリングとして知られるプロンプトの適切な構造化は、アテンションメカニズムを誘導し、結果を改善するのに役立ちます。この記事は、これらのメカニズムを理解することが、LLMを効果的に利用し、最適化するために不可欠であることを強調しています。

dev.to

Claude Code 101: Demystifying Language Models

Create attached notes ...