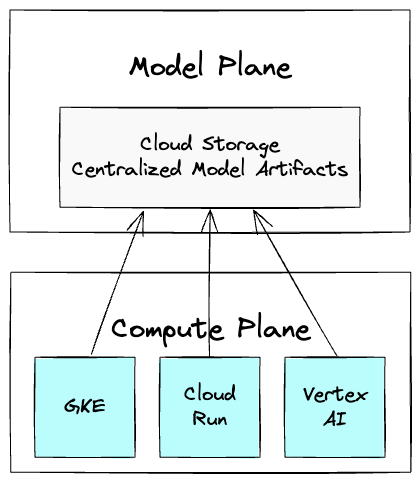

MLOpsにおいて、大規模なモデル成果物を管理することは、しばしばデプロイの遅延を招く大きな課題です。モデルをコードから切り離し、Cloud Storageでホスティングすることで、よりアジャイルなソリューションを提供できます。Cloud Storageにモデルを一元化することで、モデルはコンピューティングから独立した、それ自体のライフサイクルを持つファーストクラスの資産として扱われます。これにより、ガバナンスのための明確なモデルプレーンと、推論のためのコンピューティングプレーンが作成されます。この分離により、GKE、Cloud Run、Vertex AI間で、重複なしに単一のモデルバージョンを使用できます。整理のためのベストプラクティスには、Cloud Storageにおける明確な命名規則と環境固有のプレフィックスが含まれます。IAMを介したアクセス制御は、セキュリティと異なるユーザー権限の管理にとって不可欠です。量子化は、精度を下げることでモデルサイズを縮小し、推論を高速化します。キャッシュウォームアップは、一般的なリクエストを事前計算することで、初期プロンプト処理時間を改善できます。Cloud Storage FUSE CSIドライバーは、Cloud StorageバケットをGKEポッドに直接マウントするための推奨される方法であり、ほぼ瞬時の起動を可能にします。極端なパフォーマンスニーズには、Google Cloud Managed LustreまたはHyperdisk MLが、特殊な並列ファイルおよびブロックストレージソリューションを提供します。

cloud.google.com

Scalable AI starts with storage: Guide to model artifact strategies

Create attached notes ...