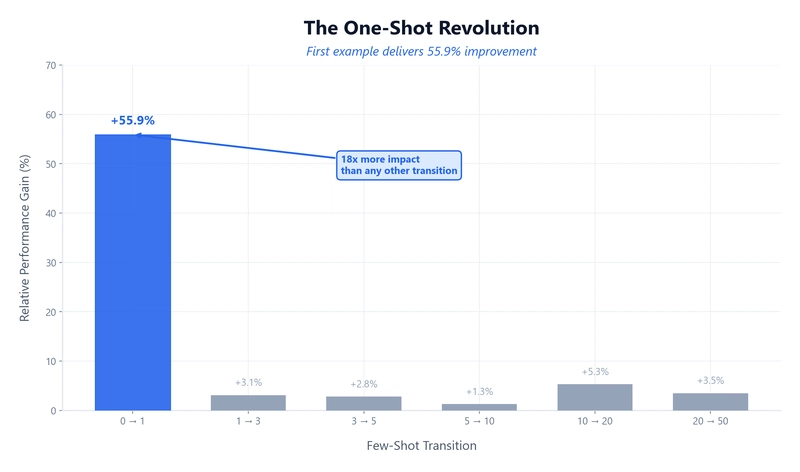

이 연구는 다양한 데이터 세트에 걸쳐 GPT-4.1-nano를 사용하여 대규모 언어 모델을 이용한 퓨샷 학습의 영향을 조사합니다. 연구 결과에 따르면 첫 번째 예제가 모델의 중요한 학습 도구 역할을 하면서 상당한 성능 향상(+55.9%)이 나타났습니다. 후속 예제는 수확 체감의 법칙을 따르며, 초기 퓨샷 예제 이후에는 개선이 미미합니다. 이러한 수확 체감 패턴은 분류 및 추출과 같은 다양한 작업에서 일관되게 나타납니다. Welch의 ANOVA를 포함한 통계 분석은 테스트된 모든 데이터 세트에서 이러한 결과의 유의미성을 확인합니다. 특히 10개 이상의 클래스를 가진 다중 클래스 작업은 더 많은 예제를 사용할수록 성능이 지속적으로 향상되는 것으로 나타났습니다. 또한 이 연구는 다양한 퓨샷 전략의 투자 수익률(ROI)을 분석하여 단일 예제를 사용하는 것이 가장 높은 ROI를 제공한다는 것을 보여줍니다. 연구에서는 간단한 작업에는 3-5개의 예제를 사용하고 클래스가 많은 작업에만 확장할 것을 권장합니다. 이 연구는 첫 번째 예제를 신중하게 작성하고 철저한 벤치마킹을 수행하는 것의 중요성을 강조합니다. 방법론에는 몬테카를로 교차 검증이 포함됩니다. 이 프로젝트는 GenAI 파이프라인 설계에 대한 이러한 결과의 실질적인 의미를 강조합니다. 마지막으로, 다음 파트에서는 고전적인 머신러닝이 회귀 작업에서 GenAI보다 여전히 우수한 성능을 보이는 이유를 살펴볼 것입니다.

dev.to

LLMs for Classification: One Example is All You Need