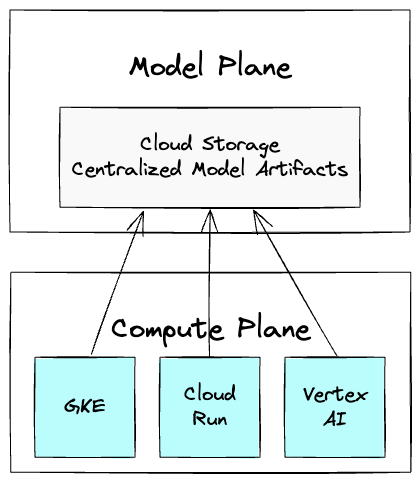

대규모 모델 아티팩트를 관리하는 것은 MLOps에서 중요한 과제이며, 종종 배포 속도를 늦춥니다. 모델을 클라우드 스토리지에 호스팅하여 코드와 분리하는 것은 보다 민첩한 솔루션을 제공합니다. 클라우드 스토리지에 모델을 중앙 집중화하면 별도의 수명 주기를 가진 일급 자산으로 취급되어 컴퓨팅과 분리됩니다. 이를 통해 거버넌스를 위한 별도의 모델 평면과 추론을 위한 컴퓨팅 평면이 생성됩니다. 이러한 분리를 통해 단일 모델 버전을 GKE, Cloud Run 및 Vertex AI에서 중복 없이 사용할 수 있습니다. 조직에 대한 모범 사례에는 클라우드 스토리지의 명확한 명명 규칙 및 환경별 접두사가 포함됩니다. IAM을 통한 액세스 제어는 보안 및 다양한 사용자 권한 관리에 중요합니다. 양자화는 정밀도를 낮춰 모델 크기를 줄이고 추론 속도를 높입니다. 캐시 워밍은 일반적인 요청을 미리 계산하여 초기 프롬프트 처리 시간을 개선할 수 있습니다. Cloud Storage FUSE CSI 드라이버는 클라우드 스토리지 버킷을 GKE 포드에 직접 마운트하는 권장 방법으로, 거의 즉각적인 시작 시간을 가능하게 합니다. 극단적인 성능 요구 사항의 경우 Google Cloud Managed Lustre 또는 Hyperdisk ML은 특수 병렬 파일 및 블록 스토리지 솔루션을 제공합니다.

cloud.google.com

Scalable AI starts with storage: Guide to model artifact strategies