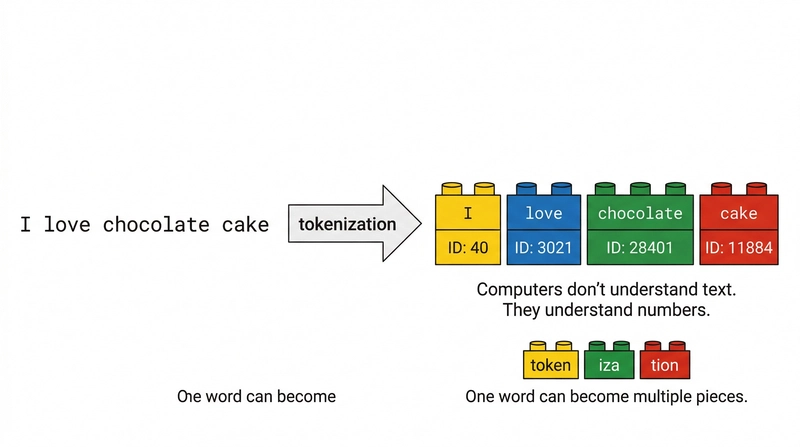

이 기사는 대규모 언어 모델(LLM)이 어떻게 작동하는지 설명하며, 이를 레고 공장에 비유합니다. LLM은 단어를 토큰으로 변환하여 텍스트를 처리하는데, 토큰은 모델이 이해하는 데이터 단위입니다. 컨텍스트 창, 즉 모델의 작업 공간은 크기가 제한되어 있어, 모델이 고려할 수 있는 정보의 양에 영향을 미칩니다. 텍스트 생성 과정은 어텐션 메커니즘에 의해 생성된 확률을 기반으로 모델이 다음 토큰을 예측하는 것을 포함합니다. 이 메커니즘은 다른 토큰과의 관계에서 각 토큰의 중요성을 가중하여 의미를 명확하게 합니다. 모델은 온도 및 top-p 설정에 의해 영향을 받는 확률 분포를 기반으로 토큰을 선택하며, 이는 무작위성을 제어합니다. 포르투갈어 텍스트는 "토큰화 프리미엄"을 발생시켜 영어보다 더 많은 토큰을 필요로 하며, 이는 비용을 증가시키고 효과적인 컨텍스트 창 크기를 줄입니다. 컨텍스트 창의 크기는 모델의 성능에 영향을 미치는 핵심 요소입니다. 텍스트 생성 비용은 모델 작동 메커니즘으로 인해 입력 비용보다 높습니다. 프롬프트 엔지니어링이라고 알려진 프롬프트의 적절한 구조화는 어텐션 메커니즘을 안내하고 결과를 개선하는 데 도움이 됩니다. 이 기사는 이러한 메커니즘을 이해하는 것이 LLM을 효과적으로 활용하고 최적화하는 데 매우 중요하다고 강조합니다.

dev.to

Claude Code 101: Demystifying Language Models

Create attached notes ...