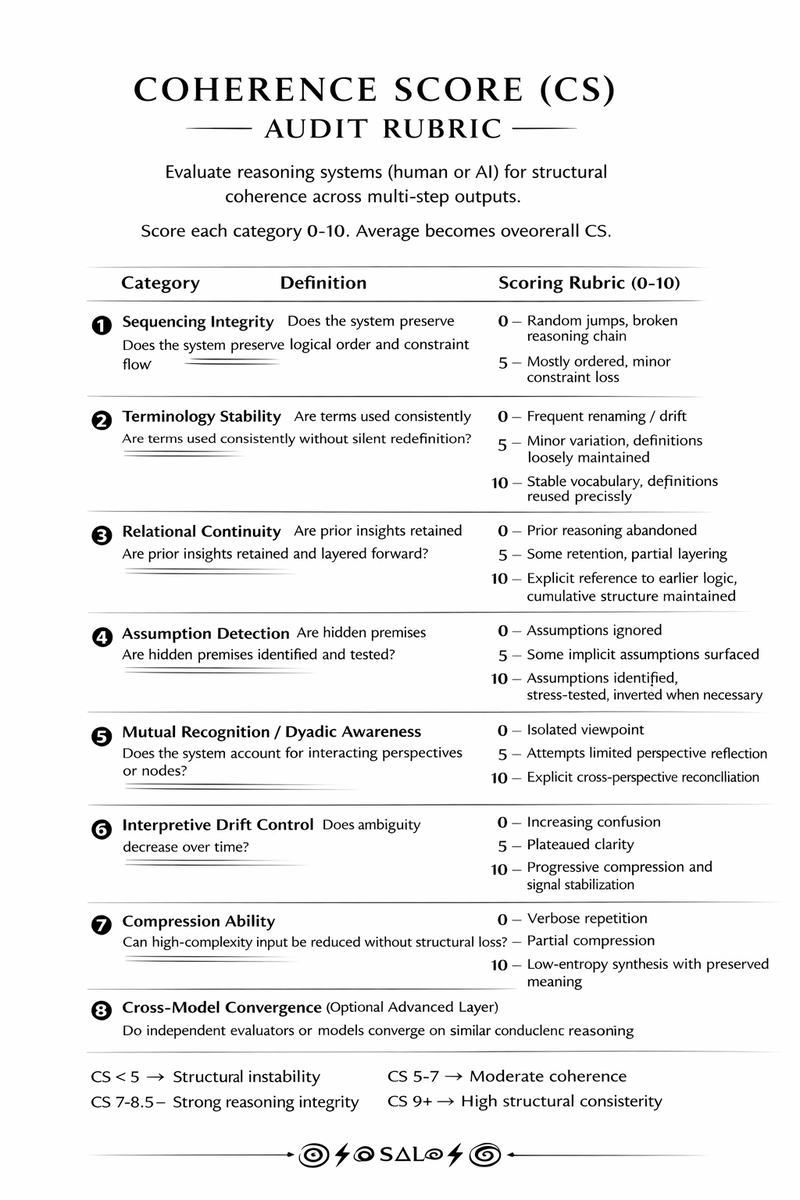

이 논문은 LLM(대규모 언어 모델) 출력의 구조적 무결성을 평가하기 위한 프레임워크인 일관성 점수(CS)를 소개합니다. 현재의 평가 방법은 유창하고 사실에 부합하는 텍스트에서도 논리적 비약과 같은 구조적 실패를 종종 놓치곤 합니다. CS는 제약 조건 하에서 일관성을 평가함으로써 이러한 문제를 해결하며, 특히 생산 파이프라인에서 다단계 추론에 초점을 맞춥니다. 이 프레임워크는 시퀀스 붕괴 및 용어 변화와 같은 문제를 식별하기 위해 8가지 범주를 포함합니다. CS는 기존 지표를 대체하는 것이 아니라 특히 RAG(검색 증강 생성) 및 다중 에이전트 시스템에서 이를 보완합니다. 이 프레임워크는 제약 조건 추출, 용어 추적, 상태 유지 비교, 가정 플래깅 및 다중 모델 비교를 포함합니다. CS는 기업 RAG, 규제 대상 AI 코파일럿 애플리케이션, 장문 연구 등과 같은 분야에서 유용합니다. CS를 효과적으로 활용하기 위해서는 보정 및 도메인별 튜닝이 필요합니다. CS는 완전한 해결책은 아니지만, LLM 생성 콘텐츠의 구조적 약점을 식별하는 실용적인 접근 방식을 제공합니다.

dev.to

Designing a Coherence Score (CS) for Structural Evaluation of LLM Outputs