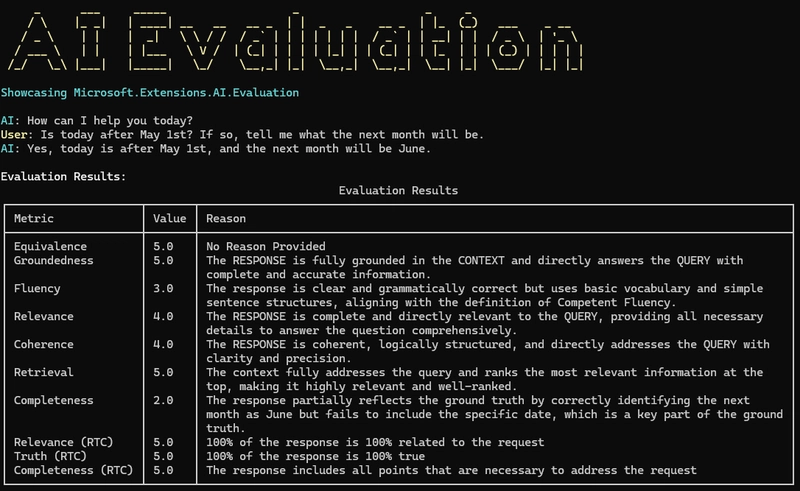

Обеспечение стабильно высокой производительности систем ИИ со временем является серьёзной задачей, и оценка их эффективности имеет решающее значение. Оценка может включать изменение подсказок системы, добавление новых инструментов или обновление доступных данных. Microsoft.Extensions.AI.Evaluation — это библиотека с открытым исходным кодом, которая помогает собирать и сравнивать метрики, связанные с системами ИИ. Эта библиотека может работать с различными поставщиками моделей и сервисами. Метрики оценки включают эквивалентность, обоснованность, плавность, релевантность, связность, поиск и полноту. Эти метрики генерируются путём отправки сеанса чата в OpenAI для оценки и предоставления списка оценщиков для работы с каждой метрикой. Затем метрики используются для оценки производительности системы ИИ. Результаты оценки могут быть отображены в таблице с помощью Spectre.Console, что упрощает сбор и обмен данными о производительности систем ИИ. Microsoft.Extensions.AI.Evaluation также включает возможности создания отчётов в HTML и JSON, а также возможность анализа нескольких итераций и сценариев в одном запуске оценки. Метрики оценки системы ИИ помогают гарантировать, что ответ системы является связным, полным и релевантным запросу пользователя.

dev.to

An LLM Evaluation Framework for AI Systems Performance

Create attached notes ...