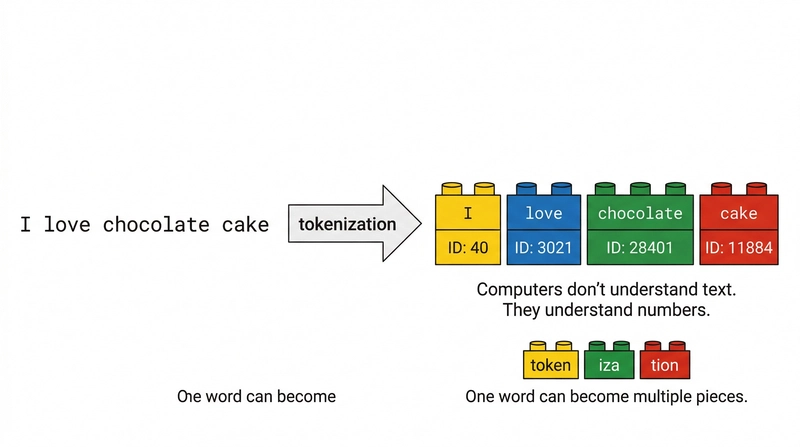

Статья объясняет, как работают большие языковые модели (LLM), сравнивая их с фабриками LEGO. LLM обрабатывают текст, преобразуя слова в токены, которые являются единицами данных, понятными модели. Контекстное окно, рабочее пространство модели, имеет ограниченный размер, влияющий на то, сколько информации она может учитывать. Процесс генерации текста включает в себя предсказание моделью следующего токена на основе вероятностей, созданных механизмом внимания. Этот механизм взвешивает важность каждого токена по отношению к другим, помогая устранить неоднозначность значений. Модель выбирает токены на основе распределений вероятностей, на которые влияют параметры температуры и top-p, контролирующие случайность. Португальский текст влечет за собой "премию за токенизацию", требующую больше токенов, чем английский, что увеличивает затраты и уменьшает эффективный размер контекстного окна. Размер контекстного окна является ключевым фактором, влияющим на производительность модели. Стоимость генерации текста выше, чем стоимость его ввода, из-за механизмов работы модели. Правильная структура подсказок, известная как проектирование подсказок, помогает направлять механизм внимания и улучшать результаты. В статье подчеркивается, что понимание этих механизмов имеет решающее значение для эффективного использования и оптимизации LLM.

dev.to

Claude Code 101: Demystifying Language Models

Create attached notes ...