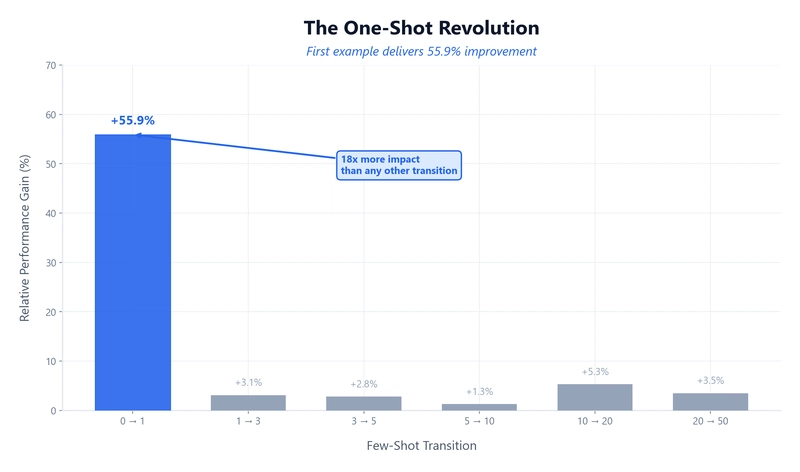

Исследование изучает влияние обучения с малым количеством примеров с использованием больших языковых моделей, в частности, GPT-4.1-nano, на различных наборах данных. Исследование выявляет значительное повышение производительности (+55,9%) от первого предоставленного примера, который выступает в качестве решающего инструмента обучения для модели. Последующие примеры приносят убывающую отдачу, с минимальными улучшениями после первых нескольких примеров. Эта закономерность убывающей отдачи наблюдается на различных задачах, таких как классификация и извлечение. Статистический анализ, включая ANOVA Уэлча, подтверждает значимость этих результатов на всех протестированных наборах данных. Многоклассовые задачи, особенно те, которые содержат более десяти классов, показывают непрерывное увеличение производительности с большим количеством примеров. Исследование также анализирует рентабельность инвестиций (ROI) различных стратегий обучения с малым количеством примеров, показывая, что использование одного примера обеспечивает наилучший ROI. Исследование рекомендует использовать 3-5 примеров для простых задач и масштабировать только для задач с большим количеством классов. Исследование подчеркивает важность тщательного создания первого примера и проведения тщательного бенчмаркинга. Методология включает в себя перекрестную проверку методом Монте-Карло. Проект подчеркивает практические последствия этих результатов для разработки конвейеров GenAI. Наконец, в следующей части будет рассмотрено, как классическое машинное обучение по-прежнему превосходит GenAI в задачах регрессии.

dev.to

LLMs for Classification: One Example is All You Need