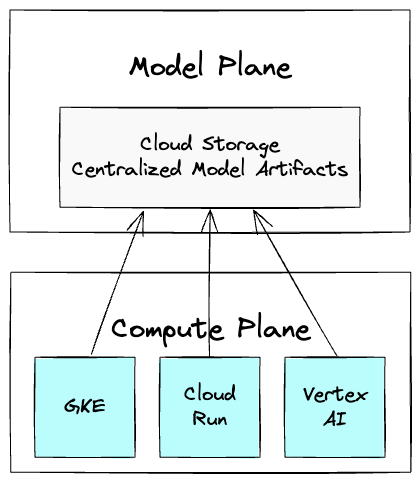

Управление большими артефактами моделей — серьезная проблема в MLOps, которая часто приводит к медленным развертываниям. Отделение моделей от кода путем их размещения в облачном хранилище предлагает более гибкое решение. Централизация моделей в облачном хранилище рассматривает их как первоклассный актив с собственным жизненным циклом, отдельным от вычислений. Это создает отдельную плоскость моделей для управления и плоскость вычислений для инференса. Такое разделение позволяет использовать одну и ту же версию модели в GKE, Cloud Run и Vertex AI без дублирования. Рекомендации по организации включают четкие соглашения об именовании и префиксы, специфичные для среды, в облачном хранилище. Контроль доступа через IAM имеет решающее значение для безопасности и управления различными разрешениями пользователей. Квантование уменьшает размер модели и ускоряет инференс за счет снижения точности. "Прогрев" кэша может сократить время обработки первых запросов, предварительно вычисляя общие запросы. Драйвер CSI Cloud Storage FUSE — рекомендуемый метод монтирования корзин облачного хранилища непосредственно в подах GKE, обеспечивающий почти мгновенный запуск. Для экстремальных требований к производительности Google Cloud Managed Lustre или Hyperdisk ML предлагают специализированные решения для параллельного файлового и блочного хранения.

cloud.google.com

Scalable AI starts with storage: Guide to model artifact strategies

Create attached notes ...