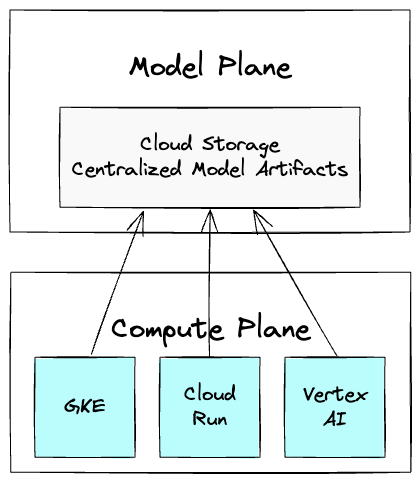

管理大型模型工件是 MLOps 中的一项重大挑战,通常会导致部署缓慢。通过将模型托管在云存储中与代码分离,可以提供更灵活的解决方案。将模型集中在云存储中,将它们视为具有自身生命周期的第一类资产,独立于计算。这为治理创建了一个独立的模型平面,为推理创建了一个计算平面。这种分离允许在 GKE、Cloud Run 和 Vertex AI 中使用单个模型版本,而无需重复。组织最佳实践包括在云存储中清晰的命名约定和特定于环境的前缀。通过 IAM 进行访问控制对于安全和管理不同用户权限至关重要。量化通过降低精度来减小模型大小并加快推理速度。缓存预热可以通过预计算常用请求来缩短初始提示处理时间。Cloud Storage FUSE CSI 驱动程序是将云存储桶直接挂载到 GKE Pod 的推荐方法,可以实现近乎即时的启动。对于极致的性能需求,Google Cloud Managed Lustre 或 Hyperdisk ML 提供了专门的并行文件和块存储解决方案。

cloud.google.com

Scalable AI starts with storage: Guide to model artifact strategies

Create attached notes ...